I Teslas stadige jagt på perfektion inden for selvkørende biler, har producenten nu taget et stort skridt med en ny kamera-rig til dataindsamling. De eksperimentelle opbygninger, som netop nu testes på valideringskøretøjer i Los Gatos, Californien, fokuserer på at levere detaljerede sandhedsdata til neurale netværk, der træner Teslas autonome softwaresystems næste generation – særligt FSD version 14 og Robotaxi-funktioner.

Med lavt monterede bredvinkelkameraer i frontkofangerens hjørner og LiDAR placeret på taget arbejder Tesla på at styrke deres kamera-baserede arkitektur uden at kræve ny hardware i produktion. Denne artikel dykker ned i, hvordan kamera-rigs bidrager til afstandsvurdering i blindzoner og forbedrer opfattelsen ved lav hastighed i selvkørende Tesla-biler.

Hvad gør Teslas kameraopsætning unik?

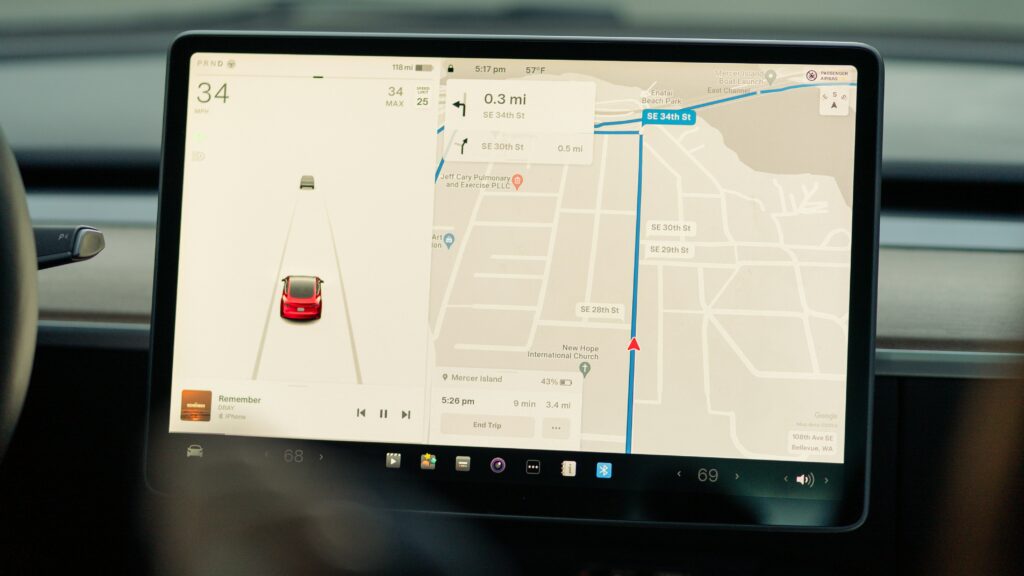

Teslas testkøretøjer skiller sig ud takket være deres specialdesignede kameraopsætning foran frontkofangerhjørner. Disse lavt placerede linser med bred synsvinkel er ikke standardudstyr i produktionen – de bruges udelukkende til at indsamle præcise data om områder, som produktionskameraer ikke fanger tilstrækkeligt.

Sammen med forbedringer i FSD version 14 danner kameraerne grundlaget for et robust neuralt netværk, der understøtter funktioner som Summon og Banish i trange parkeringsforhold. Kombinationen af lav vinkel, høj opløsning og strategisk positionering forbedrer systemets evne til estimering af objekters volumen og afstand.

Hvorfor blev LiDAR alligevel en del af testsetuppet?

Selvom Tesla traditionelt har undgået LiDAR, skiller denne testopsætning sig ud ved at kombinere LiDAR på taget i kombination med kameraer. Det skyldes ikke en ændret strategi men snarere et behov for at verificere og skabe sandhedsdata til neurale netværk.

LiDAR’en hjælper med at genere præcise pixelkort over omgivelserne i realtid – især i områder som blindzoner tæt på jorden – hvor kameraer alene kan være utilstrækkelige. Disse data bruges til at træne software, ikke til at ændre hardwaren i kundekøretøjer.

Hvordan forbedrer denne teknologi selvkørende kørsel ved lav hastighed?

Målet med systemet er at styrke bilens opfattelse ved lav hastighed i selvkørende Tesla. Funktionen er kritisk i situationer som parkeringshuse og tæt bytrafik, hvor det nuværende kamerasystem kan være utilstrækkeligt til at genkende lave forhindringer eller fjerne hjørner.

Ved at bruge data fra de lavt monterede kameraer og kombinere dem med LiDAR-rekonstruktion, lærer FSD neurale netværk at identificere og navigere komplekse miljøer langt mere præcist – noget der især kommer til udtryk i funktioner som Banish og i sidste ende Tesla Robotaxi.

Er denne udvikling relevant for Danmark?

Eftersom denne teknologi primært er i prototypefasen i USA, er tilgængelighed i Danmark endnu ikke bekræftet. Dog vil de softwareforbedringer, der udspringer af denne dataindsamling, potentielt komme danske Tesla-ejere til gode, når de inkorporeres i officielle FSD-opdateringer. Særligt på længere sigt – i takt med Robotaxi-udrulning og videreudvikling af migration af Autopilot-kode til forenede neurale netværk.

Strategisk migration af kode og neurale netværk

Denne dataindsamlingsfase understøtter ikke kun Banish og Summon, men er en del af en større strategi, hvor Tesla foretager en migration af Autopilot-kode til forenede neurale netværk. Det betyder, at funktioner tidligere kodet separat nu integreres i én arkitektonisk løsning, hvilket giver bedre tværfunktionel læring og hurtigere forbedringer på tværs af moduler.

Sådanne ændringer har allerede vist sig effektive i nyere opdateringer – se blandt andet Teslas løsning på solens blænding, hvor software finpudses uden fysisk ændring af kameraer eller sensorer.

Fremtiden for valideringskøretøjer og robotaxi-operationer

De Tesla valideringskøretøjer, der ses i Los Gatos, er en del af et større billede: forberedelsen til fremtidens autonome taxinetværk. Tesla tester kritisk teknologi til at håndtere skarpe sving, smalle parkeringspladser og tæt trafik uden menneskelig kontrol – trædestenene til en fungerende Robotaxi-operation.

Åbne tests i USA vil sandsynligvis danne grundlaget for global udrulning på sigt. Som tidligere set ved softwarefunktioner, kan disse opgraderinger blive aktiveret via over-the-air opdateringer, også for eksisterende kunder.

Ofte stillede spørgsmål om Tesla kamera-rig til dataindsamling for selvkørende teknologi (FAQ)

Hvornår vil vi se effekterne af denne teknologi i produktionsbiler?

Dataene bruges til at træne FSD-software, og forbedringer kan implementeres via softwareopdateringer i fremtidige versioner som FSD v14.

Indebærer dette en ændring i Teslas tilgang til LiDAR?

Nej, LiDAR anvendes kun i valideringsfasen som referencepunkt for sandhedsdata. Tesla holder stadig fast i en kamerabaseret produktion.

Hvad er forskellen på Summon og Banish?

Summon bringer bilen til dig, mens Banish manøvrerer bilen væk fra en position – begge forbedres med bedre blindzoneregistrering.

Er Danmark omfattet af testprogrammet?

Nej, alle testkørsler foregår i Californien. Det er endnu uvist, hvornår løsningerne eventuelt aktiveres i Danmark.

Kilder til denne artikel

- Tesla Inc. (2024). “Validation vehicles with camera rigs for FSD neural network training.” Interne ingeniør-notater.

- Analysis af The Journalist SoftAI baseret på direkte observation og Tesla-softwarehistorik.